如何快速制作虛擬數(shù)字人面部動畫(如何快速制作虛擬數(shù)字人面部動畫效果)

“忘不了你的愛,但結局難更改……”,一曲《男孩》喚起了許多人對校園生活的美好回憶,也讓盤腿而坐,抱著吉他唱著《男孩》的清華大學學生華智冰迅速出圈。而抖音美妝達人柳夜熙,憑借流暢生動的妝容分享,圈粉無數(shù),更是一躍成為虛擬人中的“帶貨一姐”。

除此之外,還有拍了VogueMe雜志,上了央視綜藝,接了特斯拉代言的打工人翎Ling,跨年演唱會上與周深同唱《小城故事》的“鄧麗君”,湖南衛(wèi)視全新綜藝《你好,星期六》啟用的數(shù)字主持人“小漾”......,各種形象、各種功能的虛擬數(shù)字人已經(jīng)不知不覺地走進了我們的生活。

而為了讓這些虛擬數(shù)字人更真實和自然,不僅需要以假亂真的建模技術,還需要在表情、動作以及交互能力上進行提升,這對虛擬數(shù)字人的制作提出了較高要求。

NVIDIA研究團隊開發(fā)了一項“黑科技”,僅需一個音頻來源,即可快速輕松生成表情豐富的面部動畫,從而能夠幫助開發(fā)者和內(nèi)容創(chuàng)作者制作出更加自然的虛擬數(shù)字人。

一、虛擬數(shù)字人面臨表情和互動不夠自然的困境

隨著元宇宙概念的大熱,以及疫情疊加下人們對數(shù)字生活需求的增加,虛擬數(shù)字人的發(fā)展步入了快車道,出現(xiàn)了很多類似于華智冰、柳夜熙、翎Ling等超寫實虛擬數(shù)字人。

而人與這些虛擬數(shù)字人最大的區(qū)別是有感情、能夠體會到喜怒哀樂,且能夠把喜怒哀樂實時地通過語言、表情等來體現(xiàn)。而虛擬數(shù)字人不具備自然表達的能力,這使得虛擬數(shù)字人被吐槽一眼假、不夠真實。

如果想為虛擬數(shù)字人引入最接近“人”的喜怒哀樂,且具有實時的交互能力,不僅要進行配音、口形適配,還要考慮當前的語態(tài)、語境,進行面部表情分離,并重新渲染面部表情。

過去常通過面捕技術來驅(qū)動虛擬數(shù)字人面部與嘴型的變化,整個環(huán)節(jié)非常復雜,時間、人力、物力成本巨大。開發(fā)者和內(nèi)容創(chuàng)作者亟需成本更低、開發(fā)更簡便的工具來降低虛擬數(shù)字人的制作門檻和成本。

二、僅需一個音頻實時生成虛擬數(shù)字人面部動畫

隨著虛擬數(shù)字人的不斷發(fā)展,AI技術成為制作虛擬數(shù)字人的重要工具。去年,NVIDIA 在其 Omniverse 平臺上推出了 Audio2Face 功能,可以讓大家輕松地為虛擬數(shù)字人制作面部動畫。現(xiàn)在點擊“”就可以觀看 Omniverse? Audio2Face 動畫演示:只需單擊按鈕即可為面部動作設置動畫效果。

Omniverse 是 NVIDIA 的實時3D設計協(xié)作和虛擬世界模擬平臺,不僅能夠加速各種復雜的3D工作流程(涵蓋從概念構思到最終交付的各個工作流程),還能夠以突破性的新方式實現(xiàn)先進創(chuàng)意和創(chuàng)新的可視化、仿真和編碼。

而 Omniverse? Audio2Face 則是一個經(jīng)過人工智能訓練的工具,僅需一個音頻來源(離線語音錄音或?qū)崟r音頻),就能立即為虛擬數(shù)字人生成富有表現(xiàn)力的面部動畫。

Audio2Face 可簡化3D角色的動畫制作,與任何配音音軌匹配,無論是為游戲、電影制作動畫角色,還是單純?yōu)榱双@得樂趣,都可以使用;還可以將其用于實時互動,或作為傳統(tǒng)的臉部動畫創(chuàng)作工具使用。

三、“全流程+低代碼”助力虛擬數(shù)字人制作便捷化

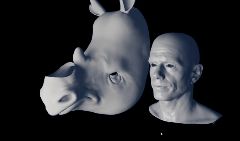

作為加速虛擬數(shù)字人制作的有力工具,Omniverse? Audio2Face 整體的運作方式如何呢?具體如下圖所示:

Audio2Face 預先載入名為“Digital Mark”的3D角色模型。此模型可按照音軌進行動畫處理,用戶只需要選取音頻并上傳至應用程序即可。該應用會將音頻輸入饋送到經(jīng)過預訓練的深度神經(jīng)網(wǎng)絡,然后根據(jù)神經(jīng)網(wǎng)絡輸出的內(nèi)容,調(diào)整角色網(wǎng)格的3D頂點,以實時創(chuàng)建面部動畫。同時,使用者還可以選擇編輯各種后制參數(shù)來優(yōu)化角色的呈現(xiàn)效果。使用者也可以逐步引導虛擬數(shù)字人的情緒,像快樂、驚奇、憤怒和悲傷等關鍵情緒都可輕松混合。

上面也體現(xiàn)了 Omniverse? Audio2Face 的兩個特點:全流程和低代碼。開發(fā)者甚至不需要掌握專業(yè)的知識,就可以完成一個虛擬數(shù)字人的制作。Omniverse? Audio2Face 還有以下幾個亮點功能:

1、音頻輸入:使用錄音或?qū)崟r制作動畫

輸入的音頻,既可以是錄制好的語音音軌,也可以是通過麥克風實時輸出的音軌。Omniverse? Audio2Face 都能夠按照這些音軌實時制作動畫。

Audio2Face 還能夠輕松處理任何語言。它還將不斷更新該應用,使其能夠處理越來越多的語言。

2、角色轉(zhuǎn)移:瞬間換臉

由于Audio2Face 預先載有“Digital Mark”的3D角色模型,所以它可以生成任何風格的人物角色或擬人角色的臉部動畫。除了虛擬數(shù)字人外,風格化虛擬角色,甚至是動物、外星人都適用。

3、擴展輸出:多音軌生成多個動畫

Omniverse? Audio2Face 還可以同時執(zhí)行多個動畫生成,如在對話的二人組、清唱的三人組和協(xié)調(diào)一致的四人組等,為虛擬數(shù)字人的歌唱注入生命與聲音。使用者也可以對每個面部表情的細膩程度進行調(diào)整,并從多個音頻源批量輸出多個動畫文件。

4、數(shù)據(jù)轉(zhuǎn)換:連接和轉(zhuǎn)換

Omniverse? Audio2Face 不僅支持 BlendShape 轉(zhuǎn)換,還支持 Blendweight 導出選項。Audio2Face 也支持通過 Epic Games UE 4 執(zhí)行導出與導入工作流程,使用 Omniverse UE 4連接器生成超人類角色的動作。

5、情感控制:選擇不同的情緒生成

除了說話外,Omniverse? Audio2Face 還可以打造各種情緒的角色動畫。神經(jīng)網(wǎng)絡會自動操縱臉部、眼睛、嘴部、舌頭和頭部運動,以匹配使用者選擇的情緒范圍和定制的情緒強度水平,或自動直接從音頻剪輯中推斷情緒。

6、Audio2Emotion:通過音頻文件生成逼真的面部表情

這是近期推出的一項新功能,讓能夠從音頻片段中推斷情感的AI自動為面部動畫設置關鍵幀,從而控制虛擬形象的情感表達。

7、全臉動畫:全臉器官的動畫生成

Omniverse? Audio2Face 除了能夠讓使用者管理虛擬數(shù)字人的皮膚以外,還可以對其眼睛、牙齒和舌頭的運動進行管理,以便制作更完整的面部動畫。

8、角色設置:更精細的角色換臉

角色轉(zhuǎn)換重定向工具現(xiàn)可支持全臉動畫,并提供易于使用的工具,用于定義構成眼睛、牙齒和舌頭的網(wǎng)格。

四、AI驅(qū)動的超寫實虛擬數(shù)字人將加速普及

近年來,AI在虛擬數(shù)字人生成和驅(qū)動上展現(xiàn)了較高的效率。過去由CG+動捕+Vocaloid語音合成方式,制作的虛擬數(shù)字人面容、身體、聲音、動作,現(xiàn)在均由AI來實現(xiàn)。而這類虛擬數(shù)字人具有真人質(zhì)感、辨識度高、互動性強的特點,是更接近人形的“超寫實虛擬數(shù)字人”。

作為 NVIDIA 研究團隊的重要成果之一,Omniverse? Audio2Face 可以使虛擬數(shù)字人的開發(fā)門檻和制作成本迅速降低,讓開發(fā)者和內(nèi)容創(chuàng)作者參與其中,加速虛擬數(shù)字人在更多場景的應用和普及。

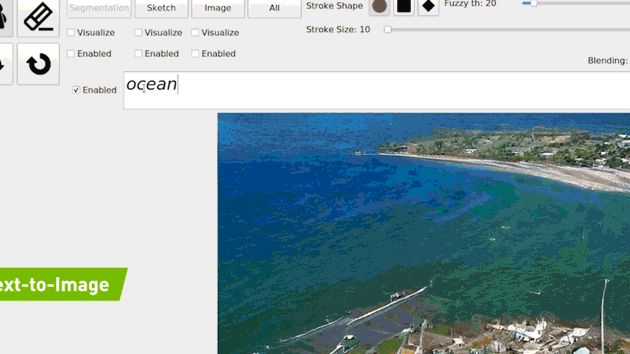

之后,我們還將陸續(xù)介紹 NVIDIA 研究團隊推出的計算機視覺、深度學習模型以及有意思的交互式Demo,如輸入文字即可P圖,秒變風景大片的 NVIDIA GauGAN2 ,輸入一句“海浪擊打岸邊石”,立刻輸出一張逼真照片。

體驗更多人工智能和深度學習互動Demo,點擊"「鏈接」"立即體驗 “NVIDIA AI 互動 Demo”。